جایگاه GPU در AI

AI

انقلابی در پردازش دادهها

پردازندههای گرافیکی Graphics Processing Units یا GPUها، در دهههای اخیر از ابزارهای تخصصی Graphic Rendering به یکی از ستونهای اصلی توسعه هوش مصنوعی تبدیل شدهاند. این تحول به دلیل نیاز روزافزون Algorithmهای Machine Learning و به ویژه Deep Learning به قدرت محاسباتی عظیم و موازی سازی پیشرفته رخ داده است. در این مقاله، به بررسی نقش کلیدی GPUها در هوش مصنوعی، دلایل برتری آنها نسبت به CPUها و تأثیرشان بر پیشرفت این حوزه میپردازیم.

چرا GPU در هوش مصنوعی مهم است؟

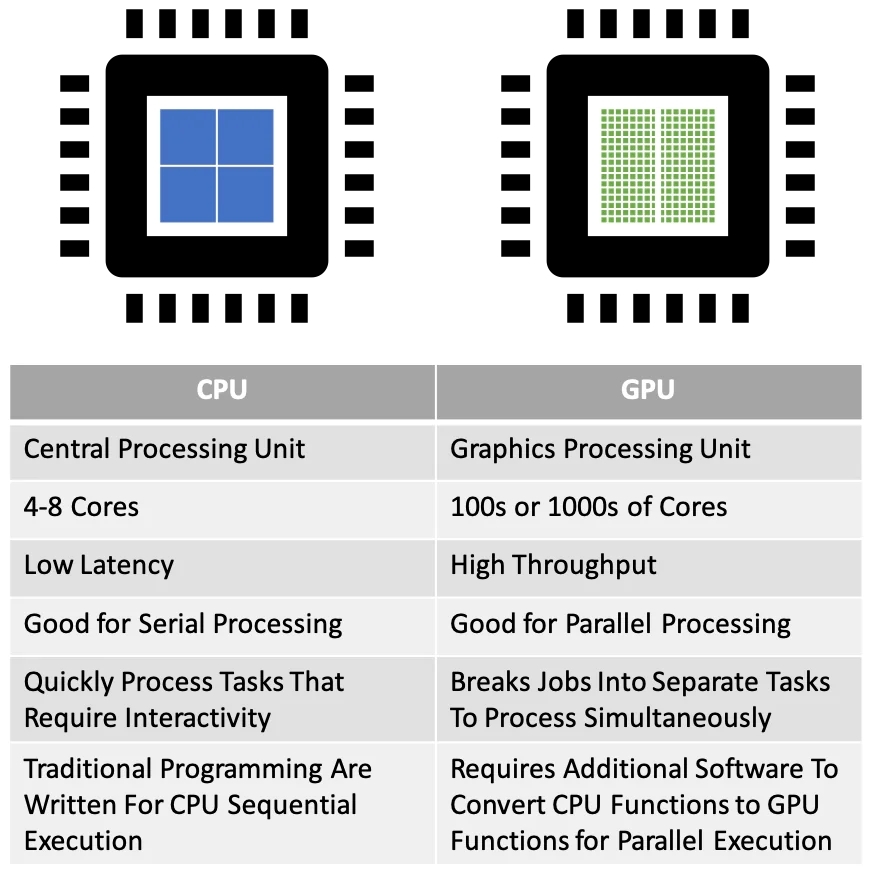

هوش مصنوعی مدرن، به ویژه در شاخههایی مانند Deep Neural Networks، نیازمند انجام محاسبات سنگین Matrix و Tensor است. این محاسبات شامل ضربهای Matrix پیچیده، بهینه سازی مدلها و پردازش حجم عظیمی از دادهها بصورت همزمان هستند. برخلاف پردازندههای مرکزی CPUها که برای اجرای متوالی دستورات بهینه شدهاند، GPUها با معماری موازی خود قادرند صدها یا هزاران هسته محاسباتی را بصورت همزمان فعال کنند. این قابلیت، زمان آموزش مدلهای هوش مصنوعی را از هفتهها به چند ساعت یا حتی چند دقیقه کاهش داده است. به عنوان مثال، در آموزش یک Deep Neural Network مانند مدلهای پردازش زبان طبیعی (NLP) یا شناسایی تصویر، میلیاردها پارامتر باید به روزرسانی شوند. این فرآیند که به Gradient Descent وابسته است، با استفاده از GPU بطور چشمگیری تسریع میشود. شرکتهایی مانند nVidia با توسعه GPUهای سری Tesla و A100، که بطور خاص برای هوش مصنوعی طراحی شدهاند، این انقلاب را رهبری کردهاند.

تفاوت GPU و CPU در هوش مصنوعی

CPUها معمولاً برای وظایف عمومی و چند منظوره طراحی شدهاند و در اجرای دستورات پیچیده و متوالی عملکرد بهتری دارند. اما در مقابل، GPUها با داشتن تعداد زیادی Coreهای سادهتر، برای پردازش موازی دادهها بهینه سازی شدهاند. به عنوان مثال، یک CPU مدرن ممکن است 4 تا 16Core داشته باشد، در حالیکه یک GPU مانند NVIDIA RTX 4090 بیش از 16000CUDA Core دارد. این تفاوت ساختاری، GPU را به گزینهای ایدهآل برای وظایف سنگین هوش مصنوعی تبدیل کرده است. علاوه بر این، GPUها از فنآوریهایی مانند حافظه با پهنای باند بالا (HBM) بهره میبرند که امکان انتقال سریع دادهها بین حافظه و Coreهای محاسباتی را فراهم میکند. این ویژگی برای مدیریت مجموعه دادههای عظیم Big Data که در هوش مصنوعی رایج است، حیاتی است.

نقش GPU در پیشرفتهای اخیر AI

بسیاری از پیشرفتهای اخیر در هوش مصنوعی، از مدلهای زبانی بزرگ مانند GPT گرفته تا سیستمهای خودران و تشخیص پزشکی، مدیون قدرت GPUها هستند. به عنوان مثال، شرکت OpenAI برای آموزش مدلهای اولیه GPT از خوشههای GPU استفاده کرد که بدون آنها چنین پروژههایی عملاً غیرممکن بود. همچنین، چارچوبهایی مانند TensorFlow و PyTorch بطور خاص برای بهرهبرداری از قابلیتهای GPU طراحی شدهاند و این وابستگی روز به روز در حال افزایش است.

چالشها و آینده GPU در AI

با وجود مزایای فراوان، GPUها با چالشهایی مانند مصرف انرژی بالا، هزینههای اولیه زیاد و نیاز به خنک کنندههای پیشرفته رو به رو هستند. به همین دلیل، رقبایی مانند TPUها (Tensor Processing Units) که توسط Google توسعه یافتهاند، در برخی کاربردها وارد میدان شدهاند. با این حال، انعطاف پذیری GPUها و پشتیبانی گسترده از آنها در Ecosystem نرمافزاری، همچنان جایگاهشان را مستحکم نگه داشته است. در آینده، انتظار میرود GPUها با ادغام فنآوریهای جدید مانند محاسبات Quantum یا بهینه سازی مصرف انرژی، نقش خود را در هوش مصنوعی گسترش دهند. همچنین، توسعه GPUهای اختصاصی برای کاربردهای خاص AI، مانند Inference در دستگاههای کوچک، نوید بخش تحولات بیشتری است.

نتیجهگیری

پردازندههای گرافیکی با فراهم کردن قدرت محاسباتی لازم برای پردازش موازی و تسریع Algorithmهای پیچیده، به یکی از ارکان اصلی هوش مصنوعی تبدیل شدهاند. بدون GPUها، پیشرفتهای امروزی در حوزههایی مانند Deep learning، Computer vision و Natural Language Processing به این سرعت ممکن نبود. با ادامه نوآوریها در این زمینه، GPUها نه تنها جایگاه خود را حفظ خواهند کرد، بلکه به عنوان محرک اصلی آینده هوش مصنوعی نیز عمل میکنند.