پروژه nVidia DIGITS

AI

DIGITS (Deep Learning GPU Training System) یک ابزار متن باز توسعه یافته توسط nVidia است که به کاربران امکان طراحی، آموزش و ارزیابی مدلهای یادگیری عمیق را روی GPUها میدهد. این Platform برای تسهیل فرآیند کار با شبکههای عصبی عمیق (DNN) طراحی شده و به ویژه برای پردازش تصاویر و بینایی کامپیوتری کاربرد دارد.

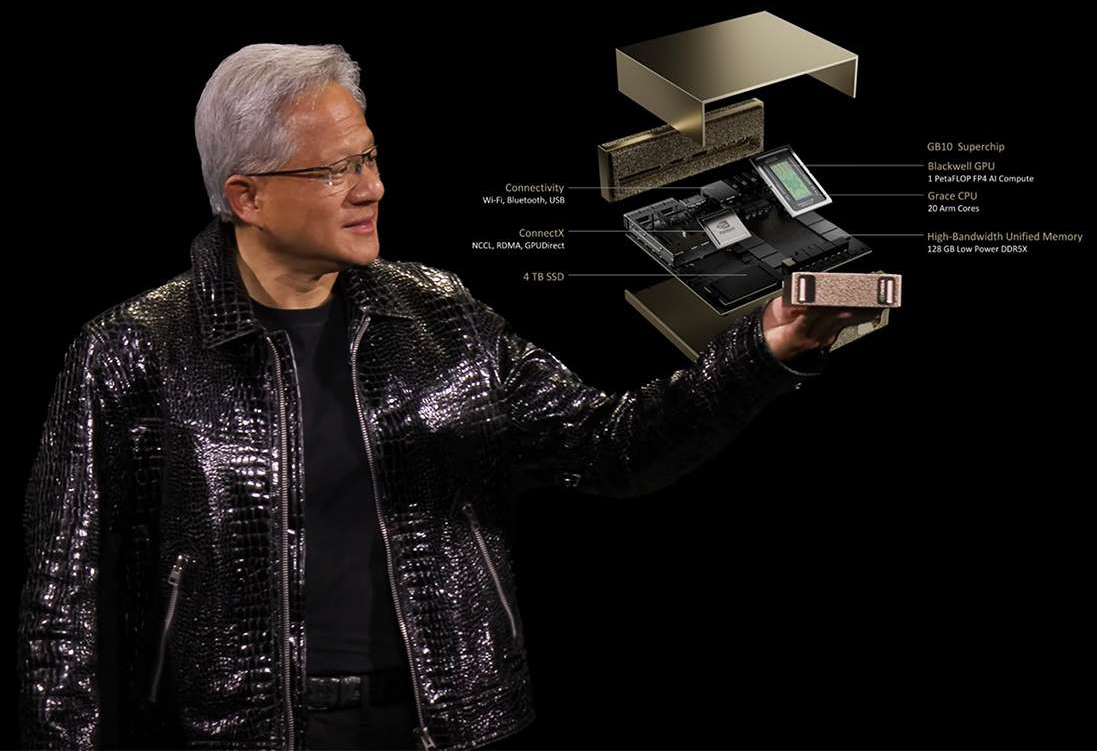

سیستم nVidia DIGITS اندازهای در حد یک کامپیوتر رومیزی دارد، میتواند مدلهای هوش مصنوعی با ۲۰۰ میلیارد پارامتر را پردازش کند. شرکت nVidia در نمایشگاه CES 2025 اعلام کرد ماه May یک ابرکامپیوتر شخصی مجهز به هوش مصنوعی را با نام Project DIGITS عرضه میکند. قلب پروژه DIGITS، تراشه فوقالعاده جدید Grace Blackwell GB10 است که قدرت پردازشی کافی برای اجرای مدلهای پیچیده هوش مصنوعی را دارد. Project DIGITS به اندازه کافی کوچک و فشرده طراحی شده است که روی میز جا بگیرد. DIGITS که ظاهری شبیه Apple Mini دارد، مدلهای هوش مصنوعی با ۲۰۰ میلیارد پارامتر را اجراء میکند و قیمت پایه آن به 3.000 دلار میرسد.

Jensen Huang، مدیرعامل nVidia در یک بیانیه مطبوعاتی گفت: هوش مصنوعی به بخش اصلی و جدایی ناپذیر هر صنعتی تبدیل خواهد شد. با پروژه DIGITS، تراشه فوقالعاده Grace Blackwell به میلیونها توسعه دهنده میرسد. با قراردادن یک ابر کامپیوتر هوش مصنوعی روی میز هر دانشمند داده، محقق هوش مصنوعی و دانشجو، آنها میتوانند در عصر هوش مصنوعی مشارکت داشته باشند و نقشی فعال در شکل دهی آن ایفاء کنند.

پروژه DIGITS از 128GB حافظه یکپارچه و تا 4TB حافظه NVMe بهره میبرد (درحالیکه بهترین Laptopها معمولاً 16 یا 32GB حافظه دارند). برای کارهای سنگینتر میتوان دو دستگاه را به هم متصل کرد تا مدلهایی با ۴۰۵ میلیارد پارامتر را پردازش کنند. برای مقایسه در نظر بگیرید که بهترین مدل Meta یعنی Llama 3.1، با ۴۰۵ میلیارد پارامتر تعلیم دیده است. تراشه 10GB قادر است در هر ثانیه یک Petaflop (هزار تریلیون) محاسبه هوش مصنوعی را با دقت FP4 انجام دهد. (FP4 با استفاده از روشهای تقریبی سرعت محاسبات را افزایش میدهد و اجرای آنها را بهینهتر میکند.) سیستم جدید nVidia از جدیدترین نسل هستههای CUDA و هستههای Tensor نسل پنجم nVidia بهره میبرد که از طریق NVLink-C2C به یک پردازنده Grace Blackwell متصل شده و دارای 20Core کم مصرف و مبتنی بر Arm است. MediaTek که در زمینه طراحی تراشههای کم مصرف شهرت دارد، در توسعه 10GB با nVidia همکاری دارد تا کارایی انرژی و عملکرد آن را بهینه کند. کاربران به مجموعه کامل کتابخانه نرمافزارهای هوش مصنوعی nVidia دسترسی خواهند داشت که گزینههایی مانند Kitهای توسعه، ابزارهای هماهنگ سازی و مدلهای از پیش آموزش دیده را شامل میشود. DIGITS از سیستم عامل لینوکسی nVidia DGX OS استفاده میکند و با چارچوبهای محبوب برنامه نویسی مانند PyTorch، Python و Jupyter سازگار است. توسعه دهندگان میتوانند با استفاده از چارچوب nVidia NeMo مدلها را بطور دقیق تنظیم کنند و با بهرهگیری از Libraryهای nVidia RAPIDS به گردش کار سریعتری در علوم داده دست یابند. به علاوه کاربران میتوانند مدلهای هوش مصنوعی خود را بصورت محلی روی پروژه Library توسعه دهند و آزمایش کنند، سپس آنها را با استفاده از همان معماری Grace Blackwell و Platform نرمافزاری nVidia AI Enterprise در سرویسهای Cloud یا Infrastructure مرکز داده پیاده سازی کنند. nVidia سیستمهای دیگری را هم با همین سبک دسترسی پذیری ارائه میدهد. برای مثال در ماه December نسخه 249 دلاری کامپیوتر Jetson خود را برای کاربردهای هوش مصنوعی معرفی کرد. این سیستم که Jetson Orin Nano Super نام دارد، بطور خاص برای علاقهمندان و Startupها طراحی شده است و میتواند مدلهایی با ۸ میلیارد پارامتر را پردازش کند.

ویژگیهای کلیدی nVidia DIGITS

1- رابط گرافیکی کاربرپسند (GUI)

- DIGITS دارای یک رابط گرافیکی تحت وب است که کاربران میتوانند بدون نیاز به کد نویسی پیچیده، مدلهای یادگیری عمیق را آموزش داده و نتایج را مشاهده کنند.

2- پشتیبانی از Libraryهای یادگیری عمیق

- DIGITS از Frameworkهای محبوب یادگیری عمیق، از جمله Caffe و Torch پشتیبانی میکند. همچنین قابلیت ارتباط با TensorFlow را نیز دارا است، اما تمرکز اصلی آن روی Caffe بوده است.

3- پردازش موازی و شتاب دهی با GPU

- با استفاده از CUDA و cuDNN، DIGITS بهینهسازی شده تا از قدرت پردازشی کارتهای گرافیکی nVidia برای آموزش مدلهای یادگیری عمیق استفاده کند. این باعث کاهش زمان آموزش مدلها نسبت به پردازشهای مبتنی بر CPU میشود.

4- مدیریت داده و پردازش پیشرفته

- قابلیت بارگذاری مجموعه دادههای سفارشی

- انجام پیش پردازش روی دادهها، مانند نرمال سازی و اعمال Data Augmentation

- نمایش بصری دادهها و وضعیت پردازش

5- ابزارهای تحلیل و بصری سازی نتایج

- رسم نمودارهای دقت و خطا در طول مراحل آموزش

- مشاهده و تجزیه و تحلیل وزنهای شبکه عصبی

- ارزیابی عملکرد مدل با نمایش نمونههای Prediction vs Ground Truth

6- پشتیبانی از چندین GPU

DIGITS میتواند مدلها را روی چندین GPU بصورت همزمان اجراء کند، که برای بهبود سرعت آموزش مدلهای بزرگ یادگیری عمیق کاربرد دارد.

7- امکان سفارشیسازی مدلها

امکان انتخاب معماریهای مختلف شبکه عصبی مانند LeNet, AlexNet, GoogLeNet, ResNet

قابلیت تعریف معماریهای سفارشی از طریق Caffe prototxt

مراحل کار با nVidia DIGITS

1- نصب و راهاندازی

برای استفاده از DIGITS، کاربران به یک سیستم با کارت گرافیک nVidia، درایور CUDA و cuDNN نیاز دارند. سپس میتوان آن را با استفاده از Docker یا بصورت مستقیم روی Linux نصب کرد.

2- آماده سازی مجموعه داده

- بارگذاری دادههای تصویری یا متنی

- برچسب گذاری دادهها در قالب LMDB یا HDF5

- انجام پردازشهای اولیه مانند تغییر اندازه تصاویر

3- تعریف و آموزش مدل

- انتخاب یک مدل پیش ساخته (مثل AlexNet) یا طراحی مدل سفارشی

- تنظیم پارامترهای آموزش مانند Learning Rate, Batch Size و Optimizer

- شروع فرآیند آموزش و نظارت بر پیشرفت

4- ارزیابی و بهینه سازی

- بررسی نمودارهای Loss و Accuracy

- انجام تست روی دادههای جدید

- بهینه سازی مدل با روشهایی مانند Fine-Tuning

کاربردهای nVidia DIGITS

1- بینایی کامپیوتری

- تشخیص اشیاء و طبقه بندی تصاویر

- شناسایی چهره و پردازش تصاویر پزشکی

2- وسایل نقلیه خودران

- تشخیص علائم راهنمایی و رانندگی

- پردازش دادههای سنسورهای تصویری

3- روباتیک و اتوماسیون صنعتی

- تشخیص الگوها در خطوط تولید

- پردازش تصاویر برای کنترل رباتها

محدودیتها و نقاط ضعف

- تمرکز بیشتر روی Caffe: اگرچه از TensorFlow پشتیبانی میکند، اما برای کاربران TensorFlow گزینه ایدهآلی نیست.

- عدم توسعه و پشتیبانی جدید nVidia: در سالهای اخیر توسعه فعال DIGITS را متوقف کرده و بیشتر به TensorRT و TAO Toolkit روی آورده است.

- مناسب نبودن برای مدلهای NLP: بیشتر تمرکز DIGITS روی پردازش تصویر است و برای پردازش متن کاربرد محدودی دارد.

جمعبندی

nVidia DIGITS یک ابزار کاربرپسند و قدرتمند برای یادگیری عمیق، مخصوصاً در پردازش تصاویر و بینایی کامپیوتری است. این Platform به کاربران امکان میدهد بدون نیاز به برنامهنویسی زیاد، مدلهای پیچیده را طراحی و اجراء کنند. با این حال، با تغییر تمرکز nVidia به ابزارهای جدیدتر مانند TAO Toolkit، این Platform دیگر بهروزرسانی نمیشود و برای پروژههای جدید شاید گزینه بهتری در دسترس باشد.